Mac에 최신 대규모 언어 모델(LLM)을 로컬로 설치하는 방법

최근 몇 년 동안 대규모 언어 모델(LLM)은 사람과 유사한 텍스트를 생성하고 다양한 작업을 지원하는 능력 덕분에 점점 더 인기를 얻고 있습니다. 모든 모델이 오픈 소스는 아니지만, 거의 모든 주요 기술 회사에서 사용자가 다운로드하여 실행할 수 있는 버전을 제공합니다.

이러한 모델을 Mac에서 로컬로 실행하는 것은 개인 정보 보호 및 비용 측면에서 모두 유익할 수 있습니다. 이 글에서는 Mac을 사용하여 LLM을 설치하고 실행하는 방법을 살펴보겠습니다. 올라마이는 개발자와 초보 사용자 모두에게 강력한 도구이며, macOS 터미널 사용을 선호하지 않는 사용자를 위해 프로세스를 간소화할 수 있는 몇 가지 그래픽 사용자 인터페이스 도구에 대해 살펴보겠습니다.

이렇게 하면 [Google], [Microsoft], [Meta] 및 [Mistral], [DeepSeek]과 같은 다른 AI 회사에서 제공하는 최신 AI 기반 텍스트 템플릿에 액세스할 수 있습니다.

LLM 이해하기: 매개변수는 무엇을 의미하는가?

설치 과정을 시작하기 전에, "와 같은 숫자가 무엇을 의미하는지 명확히 해봅시다."7B"또는"14BLLM을 언급할 때, 이 수치는 모델 크기를 나타냅니다. 선생님들 (수십억 개에 달하는) 이것들은 본질적으로 훈련 중에 정밀하게 조정되는 "손잡이와 스위치"입니다.

매개변수의 수가 많을수록 모델은 언어에서 더 복잡한 패턴과 관계를 포착할 수 있어 성능이 향상될 가능성이 있습니다. 그러나 매개변수가 많다고 항상 더 나은 결과가 보장되는 것은 아니며, 학습 데이터의 품질과 모델에 사용 가능한 컴퓨팅 자원 또한 중요한 역할을 한다는 점에 유의해야 합니다.

시스템 요구 사항

사용하시는 [Mac]이 최소한 다음 사양을 충족하는지 확인해야 합니다.

- macOS 10.15 이상 (macOS 13 이상 권장)

- 최소 8GB의 RAM (16GB 이상 권장)

- 10GB의 여유 저장 공간 (가장 작은 모델에 필요한 최소 용량이며, 최대 매개변수 수를 가진 고급 모델은 약 700GB가 필요합니다.)

- [인텔] 멀티코어 프로세서 또는 [애플 실리콘] 프로세서 (M2 이상 권장)

올라마 설치

올라마 LLM을 로컬 컴퓨터에서 직접 실행할 수 있게 해주는 오픈 소스 도구입니다. 시작하는 방법은 다음과 같습니다.

- 올라마 다운로드: 웹사이트를 방문하세요 올라마 macOS 버전을 다운로드하세요. Homebrew를 사용하여 설치할 수도 있습니다. 다음 명령어를 실행하세요.

brew install ollama터미널에서.

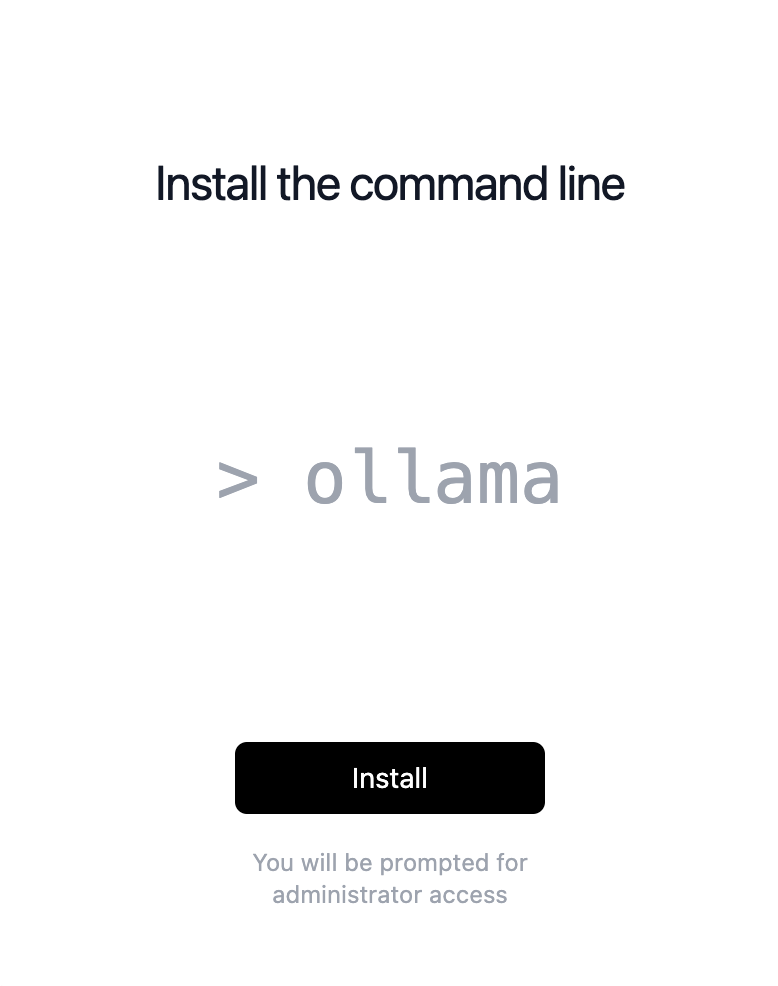

- 올라마 설치설치 프로그램을 다운로드했다면 더블클릭하고 설치 마법사의 지시에 따라 진행하세요. 홈브루를 사용하는 경우 4단계로 건너뛰세요.

- 설치자가 다음에 해야 할 일은 버튼을 클릭하는 것뿐입니다. تثبيت그러면 관리자 암호를 입력하라는 메시지가 나타납니다.

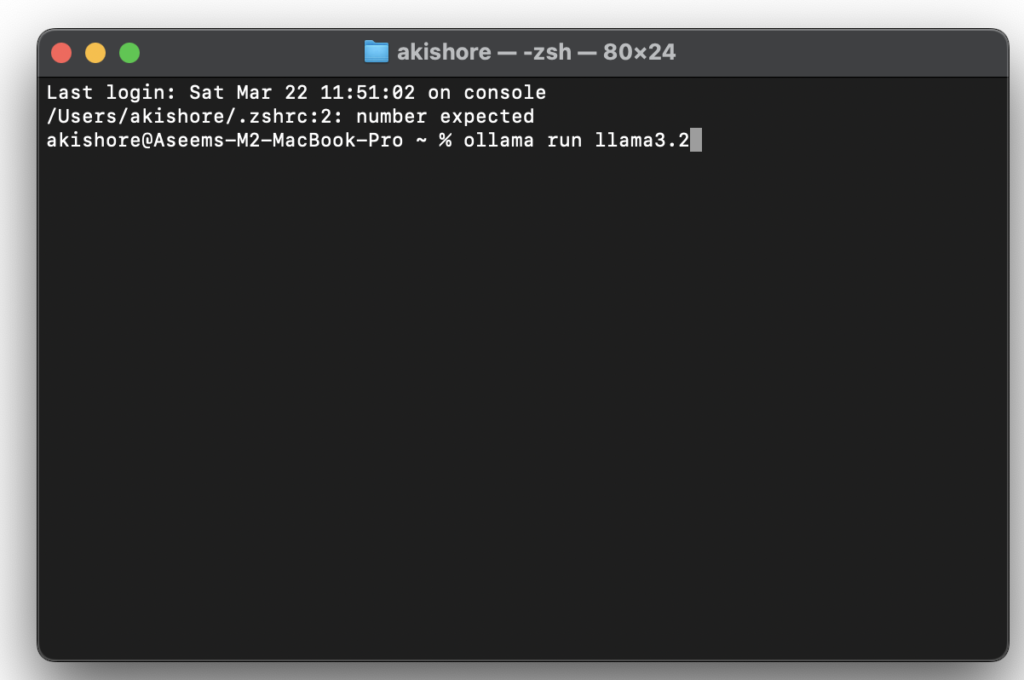

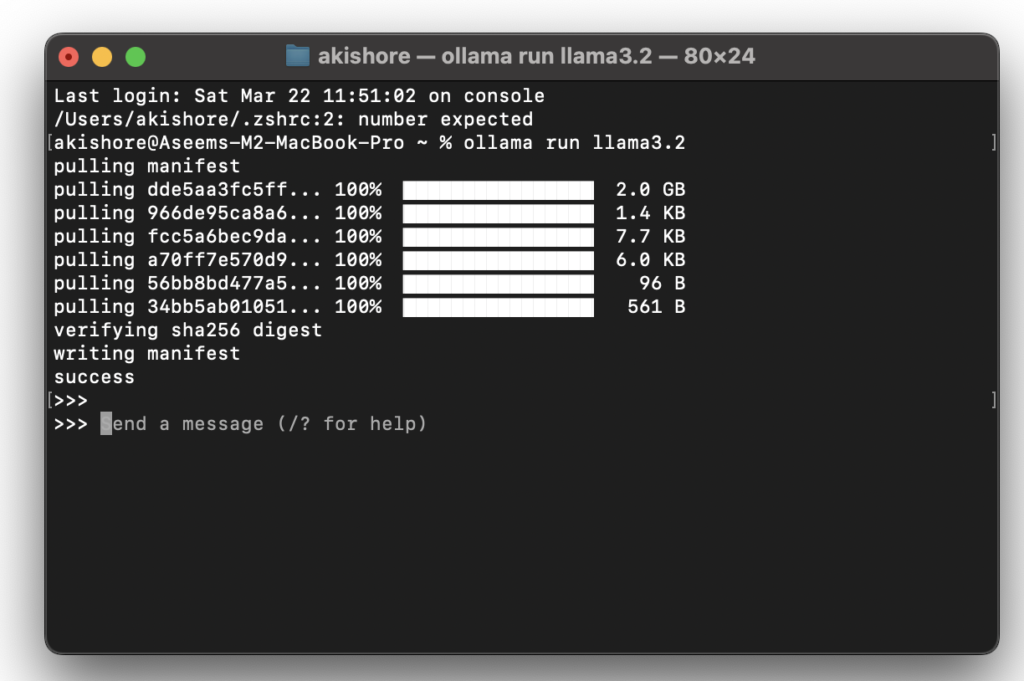

- 올라마를 달려라터미널 창을 열고 다음 명령어를 사용하여 Ollama를 서비스로 시작하세요.

brew services start ollama이렇게 하면 해당 주소에서 Ollama를 이용할 수 있게 됩니다.http://localhost:11434/. - 모델을 다운로드하고 실행하세요.명령어를 사용하세요

ollama pull <model-name>템플릿을 다운로드하려면 다음 명령어를 실행하세요.ollama run <model-name>실행하려면, 예를 들어 모델을 실행하려면 DeepSeek-R1, 명령을 사용ollama pull deepseek-r1그 다음은 주문입니다ollama run deepseek-r1. - 템플릿의 더 큰 버전을 다운로드하려면 세로 점 두 개 뒤에 크기를 입력하세요. 예를 들어, 템플릿을 다운로드하려면 다음과 같이 하면 됩니다. 14B 딥시크명령어를 사용하게 됩니다. ollama 런 deepseek-r1:14bOllama 웹사이트에서는 어떤 양식이든 클릭하면 각 버전에 대한 모든 명령어가 표시됩니다.

전체 목록은 여기에서 확인할 수 있습니다. 올라마 모델 여기 있습니다. 위에서 설명한 대로 두 번째 명령어를 사용할 수도 있습니다. 만약 설치되어 있지 않다면, 먼저 양식을 다운로드한 후 실행합니다.

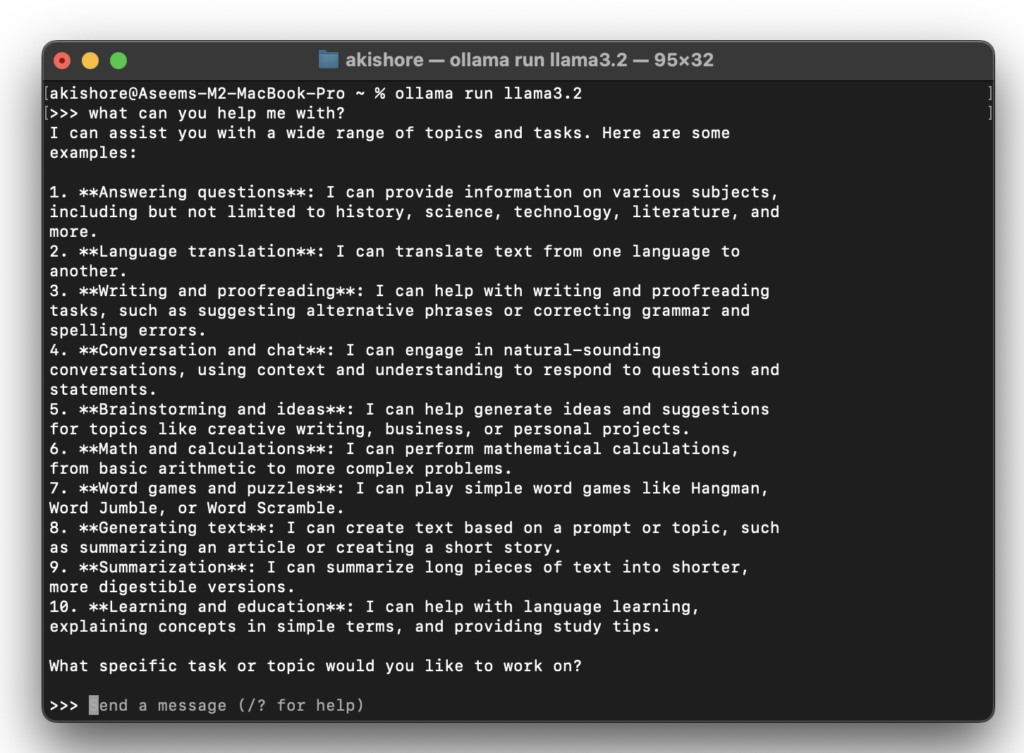

이제 직각 화살표 세 개(>>>)가 보이시죠? 이제 폼에 명령어를 입력하실 수 있습니다.

이제 끝입니다! 비용이나 과다 사용, 또는 다른 사람이 내 글을 읽을까 걱정하지 않고도 AI LLM과 로컬에서 소통할 수 있습니다. 민감하거나 개인적인 주제를 AI LLM과 논의하고 싶지만, 대형 IT 기업이 내 생각을 읽는 것을 원치 않는 경우에 특히 유용합니다.

Ollama에서 그래픽 사용자 인터페이스 도구 사용하기

Ollama는 개발자에게 강력하고 효율적인 도구이지만, 일부 사용자는 LLM과 상호 작용하는 데 그래픽 사용자 인터페이스(GUI)를 선호할 수 있습니다. 다음은 Ollama에 GUI 프런트엔드를 제공하는 몇 가지 도구입니다.

-

-

- 올라마 GUI이 프로그램은 macOS 사용자를 위한 무료 오픈 소스 애플리케이션으로, SwiftUI로 개발되었습니다. 아름다운 인터페이스를 제공하며, 터미널을 사용하지 않고 로컬에서 LLM 양식에 접근하려는 사용자에게 탁월한 선택입니다.

- 올라마 UI간단한 HTML 기반 웹 사용자 인터페이스를 통해 브라우저에서 직접 양식을 정의하고 상호 작용할 수 있습니다. 간편한 사용을 위해 크롬 확장 프로그램도 포함되어 있습니다.

- 챗박스 AI이것은 초보자에게 가장 쉬운 옵션이며, 아래에서 사용 방법을 설명하겠습니다. 참고로, Chatbox AI 서비스는 구독 서비스이므로 Ollama를 직접 설치하지 않고도 모든 LLM 템플릿에 액세스할 수 있습니다.

-

최적의 챗봇 AI 인터페이스를 사용하려면 다음으로 이동하세요. 다운로드 페이지 맥용 버전을 다운로드하세요.

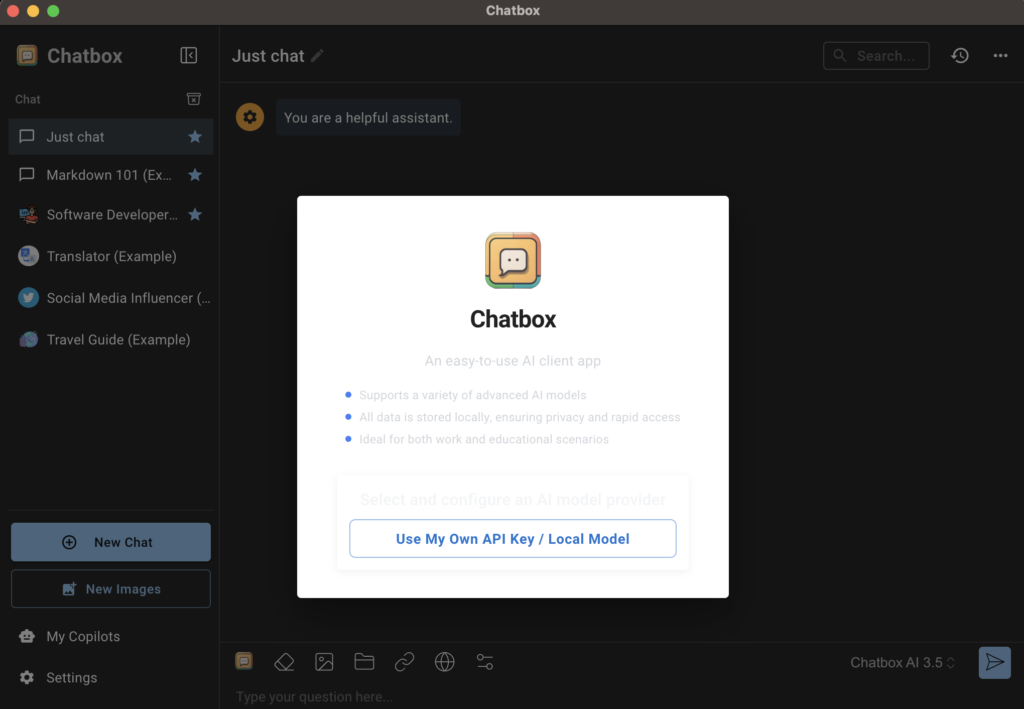

다음으로 설치 프로그램을 열고 프로그램을 실행하세요. 첫 화면에 Chatbox AI 사용 방법을 묻는 팝업 창이 나타납니다.

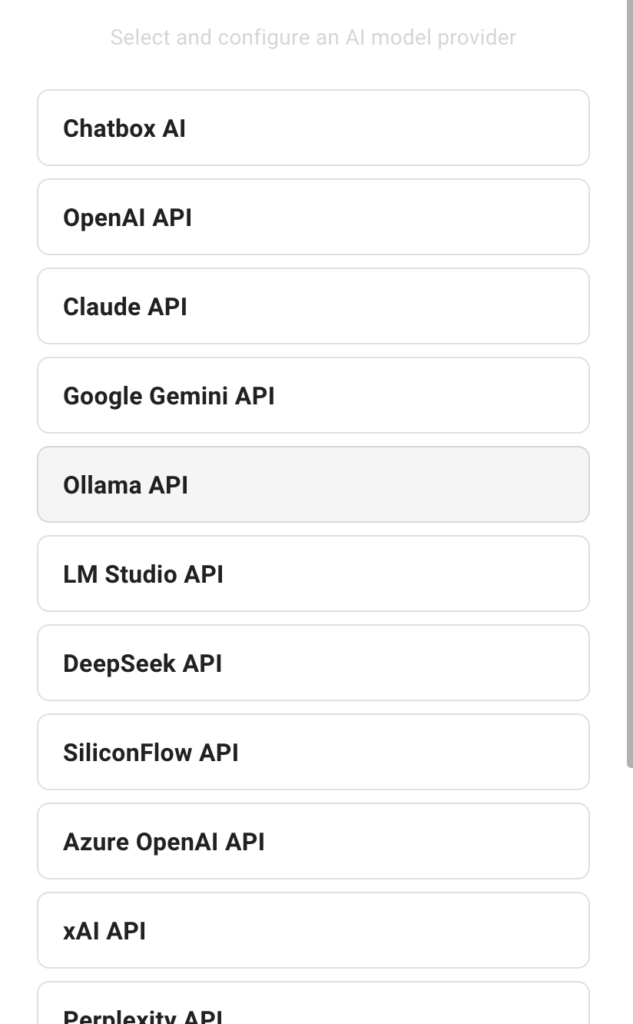

버튼을 클릭해야 합니다. 내 API 키/로컬 모델 사용.

다음으로 올라마 API 인공지능 모델 제공업체로서.

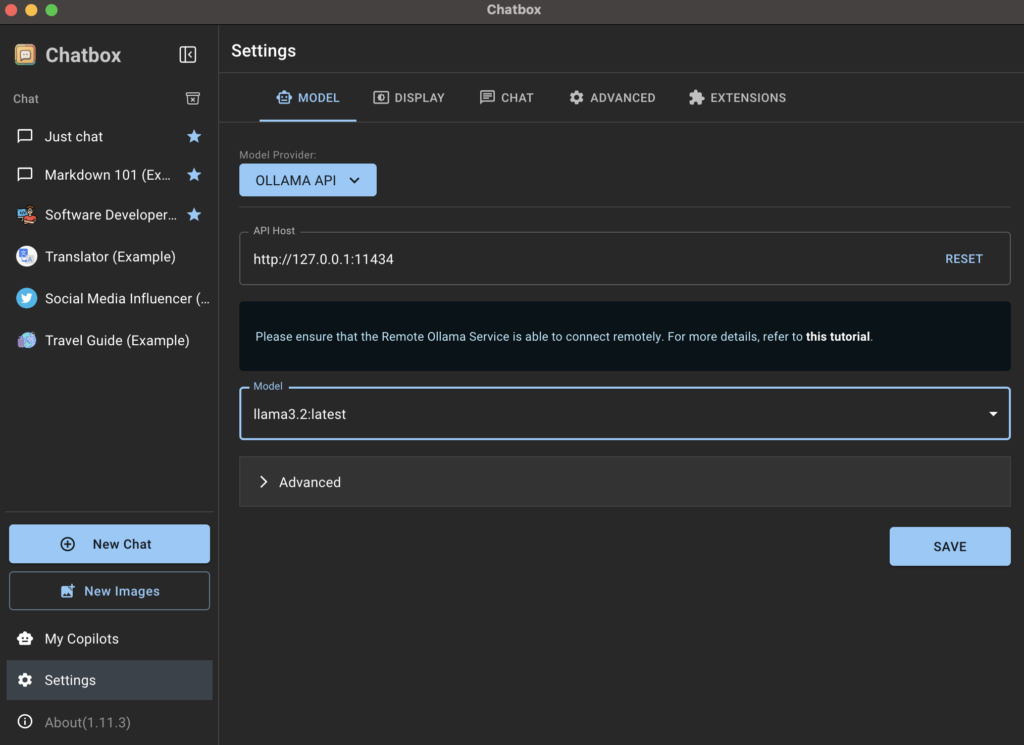

Chatbox AI는 Ollama가 실행 중임을 자동으로 감지하고 API 호스트를 기본값으로 설정해야 합니다. 루프 반환 IP 주소 및 포트 번호 11434여기서는 아무것도 변경할 필요가 없습니다. 양식 안에는 이전에 터미널을 사용하여 설치한 양식들이 표시될 것입니다. 제 경우에는 해당 양식이 표시됩니다. 라마 3.2.

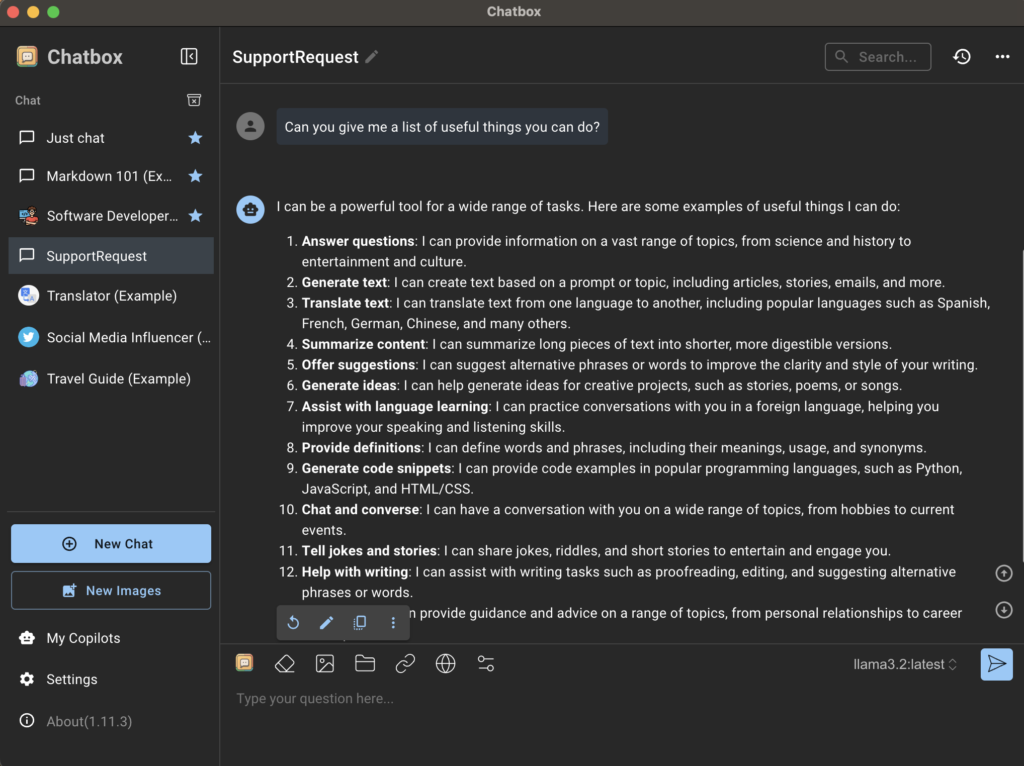

앱의 홈 페이지로 돌아가서 다음을 클릭하세요. 그냥 수다 떨자 또는 새로운 채팅 오른쪽 하단에서 올바른 템플릿을 선택했는지 확인하세요. 템플릿은 언제든지 변경할 수 있지만, 차이점을 쉽게 확인할 수 있도록 사용하는 템플릿마다 새 채팅방을 만드는 것이 좋습니다.

LLM 모델을 로컬에서 실행하기 위한 대체 도구

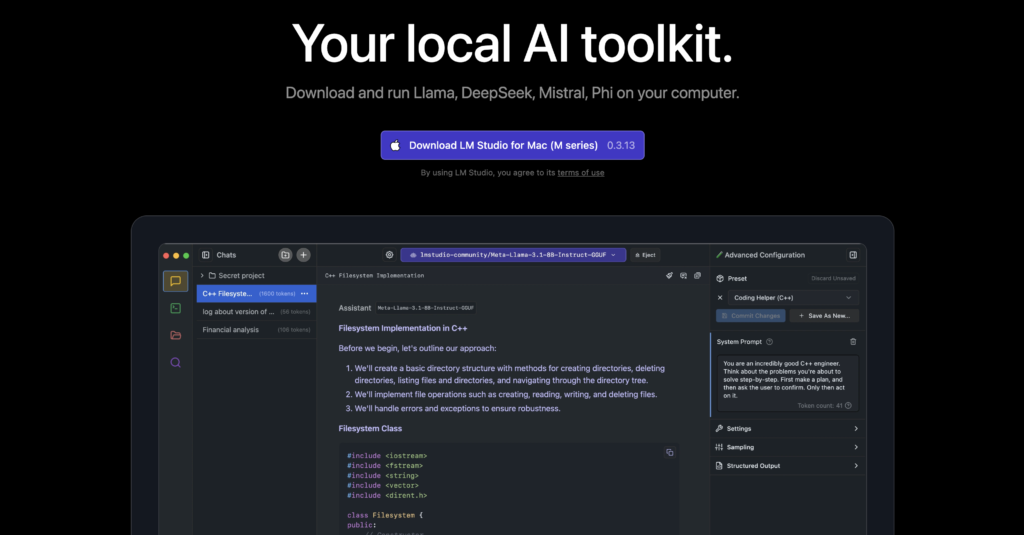

Ollama의 대안을 찾고 있거나 처음부터 더 사용자 친화적인 경험을 원한다면, LM스튜디오 이것도 훌륭한 선택지입니다. 사용자 친화적인 인터페이스를 제공하여 다양한 AI 모델을 탐색하고 사용할 수 있으며, 쉽게 다운로드하고 실행할 수 있습니다. LM Studio는 Linux, Mac, Windows에서 사용할 수 있으며 모델 매개변수 및 채팅 기록 사용자 지정과 같은 기능을 제공합니다. 현재 무료이기 때문에 Chatbox AI 구독 서비스보다 추천합니다.

결론

맥에서 대규모 언어 모델(LLM)을 로컬로 실행하는 것은 AI 애플리케이션에 대한 제어권을 강화하고 데이터 개인정보 보호를 우선시하는 모든 사용자에게 중요합니다. Ollama와 앞서 언급한 그래픽 사용자 인터페이스와 같은 도구를 사용하면 LLM을 워크플로에 쉽게 통합하여 생산성과 창의성을 안전하게 극대화할 수 있습니다.

하지만 로컬 LLM 배포를 시작하려면 매개변수와 이러한 매개변수가 특정 컴퓨터에서 모델 성능에 미치는 영향을 이해해야 합니다. 이를 학습하는 가장 좋은 방법은 다양한 모델을 직접 실험해보고 어떤 모델이 최상의 결과를 제공하는지 확인하는 것입니다. 이 개념을 이해하고 나면 어떤 모델을 사용할지, 그리고 특정 요구 사항에 맞게 성능을 최적화하는 방법을 더 잘 결정할 수 있게 됩니다.

댓글이 닫혀있다.