Windows 11 컴퓨터에서 대규모 언어 모델(LLM)을 실행하기 위해 Ollama를 설치하고 사용하는 방법

Windows 컴퓨터에서 대규모 언어 모델(LLM)을 로컬로 실행하는 방법은 여러 가지가 있지만 Ollama는 가장 간단하고 효율적인 방법 중 하나입니다.

현재 우리 대부분이 AI와 가장 흔하게 상호 작용하는 것은 클라우드 기반 도구와 같은 것입니다. ChatGPT 또는 부조종사이러한 도구를 사용하려면 인터넷 연결이 필요하지만, 그 대신 거의 모든 기기에서 사용할 수 있다는 장점이 있습니다.

하지만 모든 사람, 특히 개발자들이 AI 애플리케이션에 클라우드를 의존하고 싶어 하는 것은 아닙니다. 따라서 대규모 언어 모델(LLM)을 기기에서 로컬로 실행해야 합니다. 바로 이 부분에서 Ollama가 등장합니다.

Ollama는 컴퓨터에서 다양한 대규모 언어 모델(LLM)을 네이티브로 실행할 수 있는 추론 도구입니다. 유일한 방법은 아니지만, 가장 간단하고 직관적인 방법 중 하나입니다. Ollama를 사용하면 인터넷에 계속 연결하지 않고도 AI의 힘을 활용할 수 있으므로 데이터와 개인 정보를 완벽하게 제어할 수 있습니다.

Ollama를 설치하고 실행하면 Ollama와 Ollama가 사용하는 대규모 언어 모델(LLM)을 활용하여 다양한 작업을 할 수 있지만, 첫 번째 단계는 설정입니다. 이 강력한 도구를 최대한 활용할 수 있도록 설정 과정을 단계별로 안내해 드리겠습니다.

Ollama 시스템 요구 사항

Ollama 자체는 시스템 리소스를 많이 소모하지 않으며 다양한 기기에서 실행할 수 있습니다. Windows 11, macOS, Linux와 호환됩니다. WSL을 통해 Windows 11 내의 Linux 배포판에서도 사용할 수 있습니다.

하지만 대규모 언어 모델(LLM) 자체를 실행하려면 더 강력한 하드웨어가 필요합니다. 모델이 클수록 더 높은 처리 능력이 필요합니다. 이러한 모델을 실행하려면 그래픽 처리 장치(GPU)가 필요합니다. 현재 새로운 Copilot+ PC의 신경망 처리 장치(NPU)에는 최적화되어 있지 않습니다.

다행히도, 적당한 하드웨어에서 사용할 수 있는 소형 모델들이 있습니다. 예를 들어, 구글의 Gemma 3 모델은 1억 개의 매개변수를 가진 모델로, 전체 모델을 실행하는 데 2.3GB의 VRAM(Visual Random Access Memory)만 필요합니다. 9억 개의 매개변수를 가진 모델로 업그레이드하면 VRAM 용량이 4GB 이상으로 늘어납니다.

Meta의 Llama 3.2도 마찬가지입니다. 1억 개의 매개변수를 가진 모델을 성공적으로 실행하려면 4GB의 VRAM만 있는 GPU가 필요합니다. 8억 개의 매개변수를 가진 모델의 경우 VRAM이 3GB로 증가합니다.

간단히 말해, 최소 8GB의 RAM과 전용 GPU가 장착된 비교적 현대적인 컴퓨터가 있다면 Ollama를 사용하여 어느 정도 이점을 얻을 수 있습니다.

Windows 11에 Ollama 설치 가이드

Windows 11에 Ollama를 설치하는 것은 매우 간단한 과정이며 다운로드로 요약됩니다. 공식 홈페이지에서 프로그램을 설치하세요 또는 GitHub 저장소을 클릭한 다음, 기기에 설치하세요.

간단한 단계는 다음과 같습니다.

설치 및 실행 후 바탕 화면에 아무것도 나타나지 않습니다. 프로그램은 완전히 백그라운드에서 실행되지만 작업 표시줄에서 아이콘을 확인할 수 있습니다.

프로그램이 제대로 작동하는지 확인하려면 다음 주소로 이동하세요. localhost : 11434 웹 브라우저에서.

Ollama에서 첫 번째 대규모 언어 모델(LLM)을 설치하고 실행하세요.

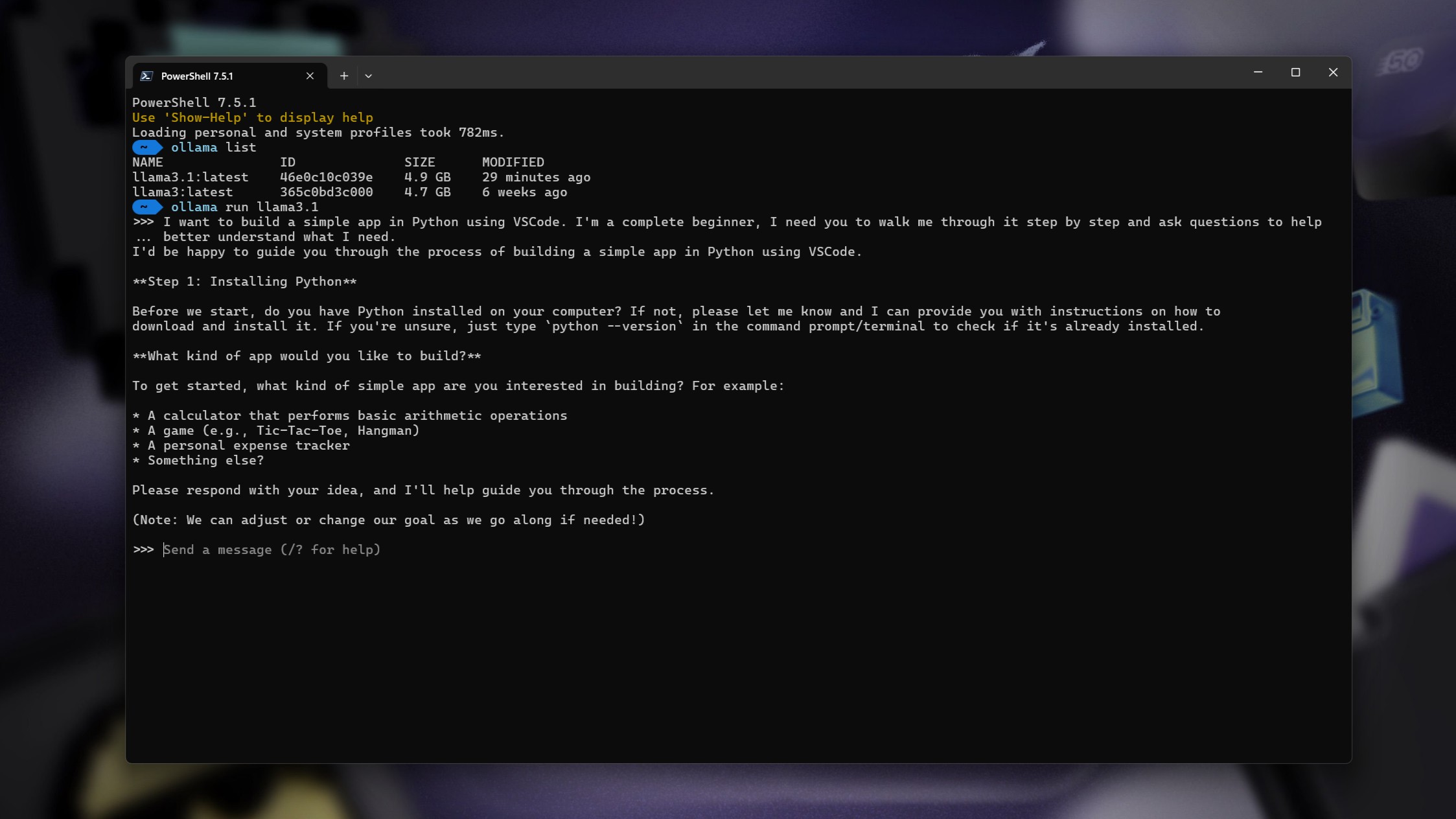

Ollama를 사용하여 첫 번째 대규모 언어 모델(LLM)을 실행하려면 기본적으로 명령줄 인터페이스(CLI)를 사용해야 합니다. Windows에서 PowerShell을 열거나, Ollama가 설치되어 있다면 WSL을 사용하세요.

Ollama에는 그래픽 사용자 인터페이스(GUI)가 있지만, 여기서는 명령줄 사용에 중점을 둡니다. CLI 사용에 익숙하다면 도움이 될 것입니다.

꼭 알아야 할 두 가지 중요한 사항은 다음과 같습니다.

달리고 있다

올라마 풋

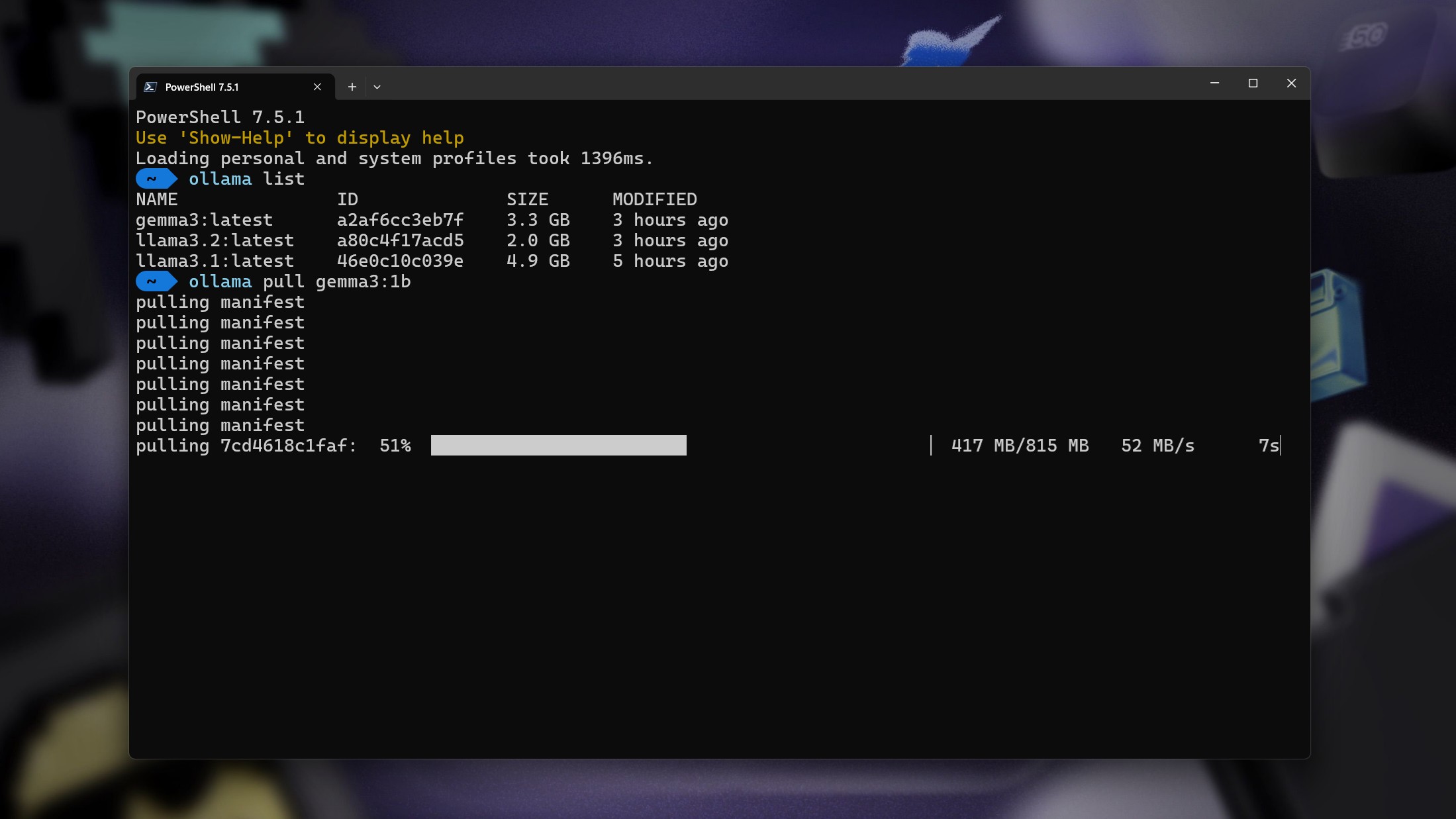

Ollama에 현재 설치되지 않은 LLM 모델을 실행하도록 요청하면 Ollama가 자동으로 해당 모델을 다운로드한 후 실행합니다. 설치하려는 대규모 언어 모델의 정확한 이름은 다음에서 쉽게 찾을 수 있습니다. 올라마 웹사이트.

예를 들어, 3억 개의 매개변수를 가진 Google Gemma 1 LLM 모델을 설치하고 실행하려면 다음 명령을 입력하세요.

올라마 런 제마:1b

추가에 유의하세요 :1b 이름 뒤에 1억 개의 매개변수 모델을 원한다고 명시하세요. 4억 개의 매개변수 모델을 원하면 **:4b**로 변경하세요.

터미널에서 양식을 실행하면 익숙한 챗봇 환경이 열리고, 프롬프트를 작성하고 응답을 받을 수 있으며, 이 모든 작업은 기기에서 로컬로 실행됩니다.

양식을 종료하고 PowerShell로 돌아가려면 **/bye**를 입력하기만 하면 프로세스가 종료됩니다.

이 가이드에서는 Ollama를 컴퓨터에 설치하여 제공되는 LLM(학사 학위)을 사용하는 기본적인 방법을 다룹니다. 기본적인 사용 환경은 매우 간단하고 사용하기 쉬우며, 기술적인 지식이 거의 필요하지 않습니다. 제가 할 수 있다면 여러분도 할 수 있습니다!

댓글이 닫혀있다.