Microsoft, DeepSeek R4과 경쟁할 초추론 AI 모델 Phi-1 출시

요약:

- Microsoft는 4억 개와 14억 개의 매개변수로 학습된 Phi-3.8 추론 AI 모델을 출시했습니다.

- Phi-4 추론 모델은 크기가 작음에도 불구하고 DeepSeek R1 및 o3-mini와 같은 훨씬 더 큰 모델과 경쟁합니다.

- Microsoft에서는 Phi-4 추론 모델이 크기가 작기 때문에 Windows Copilot+를 실행하는 PC에서 실행할 수 있다고 말합니다.

Microsoft는 Phi-4-reasoning, Phi-4-reasoning-plus, Phi-4-mini-reasoning 등 세 가지 새로운 추론 AI 모델을 출시했습니다. 이 모델들은 Windows PC 및 모바일 기기와 같은 엣지 디바이스용으로 설계된 소형 언어 모델입니다. Phi-4-reasoning AI 모델은 14억 개의 매개변수로 학습되었으며 복잡한 추론 작업을 수행할 수 있습니다.

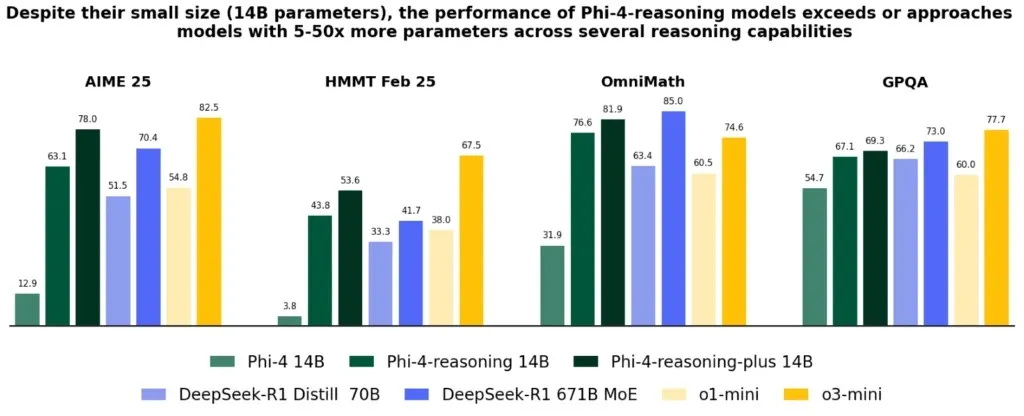

Phi-4-reasoning-plus 모델은 동일한 기본 모델을 사용하지만, Phi-4-reasoning 모델보다 약 1.5배 많은 토큰 수를 사용하는 추가적인 추론 시간 계산을 통해 더 높은 정확도를 제공합니다. Phi-4-reasoning 모델의 크기는 작지만, 다음과 같은 더 큰 모델과 경쟁할 수 있습니다. 딥시크 R1 671B와 o3-mini.

GPQA 표준에서 Phi-4-reasoning-plus-14B 모델은 69.3%의 점수를 달성하는 반면 o3-미니 77.7%. AIME 2025 테스트에서 Phi-4-reasoning-plus-14B는 78%, o3-mini는 82.5%를 기록했습니다. 이는 Microsoft mini 모델이 훨씬 더 큰 크기의 주 추론 모델과 매우 유사함을 보여줍니다.

Microsoft는 Phi-4 추론 모델이 지도 미세 조정을 통해 훈련되었다고 말합니다.OpenAI o3-mini의 신중하게 큐레이팅된 추론 데모에 관하여"또한" Microsoft는 다음과 같이 썼습니다.이 모델은 정확한 데이터 형식과 고품질 합성 데이터 세트를 통해 작은 모델도 큰 모델과 경쟁할 수 있음을 보여줍니다.. "

더욱이, 4억 개의 매개변수로만 학습된 더 작은 Phi-3.8-mini-reasoning 모델은 여러 7B 및 8B 모델보다 우수한 성능을 보입니다. AIME 24, MATH 500, GPQA Diamond와 같은 벤치마크에서 Phi-4-mini-reasoning-3.8B 모델은 o1-mini 모델과 거의 비슷한 수준의 경쟁력 있는 결과를 제공합니다.헠헠파이-4-미니 모델Deepseek-R1 모델에서 생성된 합성 데이터를 정확하게 활용. "

Microsoft의 Phi 모델은 이미 Windows 컴퓨터에서 기본적으로 사용됩니다. 부조종사 + PC내장된 신경 처리 장치를 활용합니다. Phi-4의 추론 모델이 기기 내 AI 성능을 어떻게 향상시킬지 지켜보는 것은 흥미로울 것입니다.

댓글이 닫혔습니다.